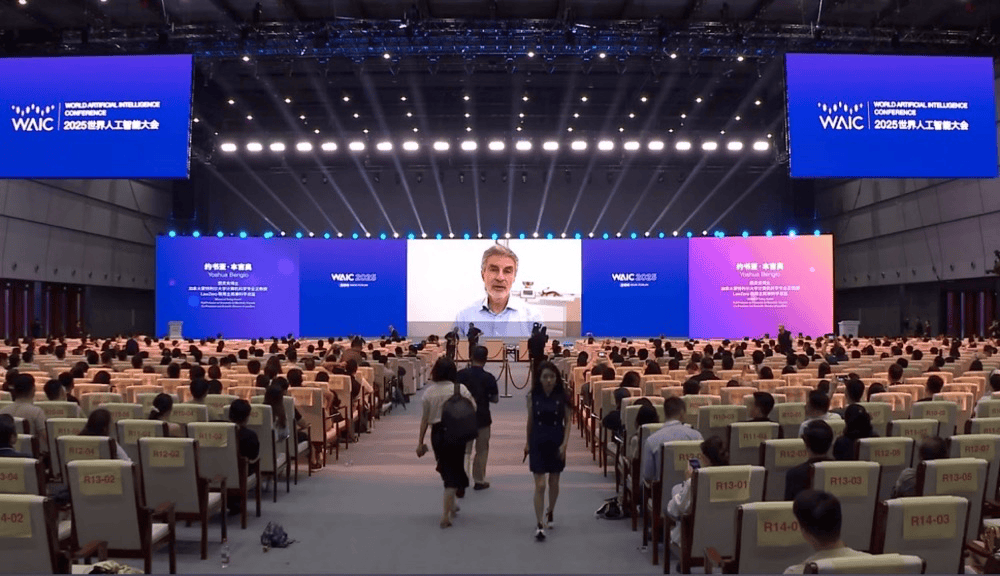

7月26日,2025世界人工智能大会在上海开幕,图灵奖得主约书亚·本吉奥在主论坛上带来视频演讲。

他表示,前沿模型近期在规划和推理方面取得了显著进展。如果这样的趋势持续,人工智能的规划推理能力有望在十年内达到人类的水平。

本吉奥强调,如果缺乏坚实的防护措施,强大的人工智能系统可能会放大现有的风险,比如虚假信息,网络攻击和生物威胁。更令人担忧的是,我们可能会失去对自我保护型智能体的控制,很快这些智能体的认知能力获或将超越人类。

“即便风险很小,超级智能与人类竞争也可能带来灾难性后果,甚至导致人类灭绝。”本吉奥认为,科学界仍有相当比例认为这种情况可能发生,就必须保持最高警惕。

本吉奥表示,目前尚无科学验证方法确保人工智能可信且始终遵从人类意图。更糟糕的是,欺骗和自我保护行为在最强模型中似乎更加明显。

“随着人工智能的智能水平不断提升,这是才是真正令人担忧的地方,因为智能意味着权利。”

本吉奥提到,在商业层面,进一步提升模型推理能力和自主性的动力也非常强烈。这些进展有助于提升生产效率和经济发展,但也可能加剧前面提到的诸多风险,尤其在监管尚未完善的情况下更是如此。

本吉奥表示,我们急需在技术和政策的层面采取措施,应对这些风险和其他潜在的问题。

本吉奥认为,理性的政策应鼓励开发不具备危险能力的人工智能开源项目;同时,禁止其他情况下的开发,并对闭源模型实施充分的安全保障措施,包括网络安全和物理安全,确保其不易被犯罪分子、恐怖分子或流氓国家所利用。

他也提醒,一个足以被武器化的模型表明,通用人工智能的未来仍充满不确定性,极端正面与极端负面的结果皆有可能。这在很大程度上将取决于社会和政府如何行动。